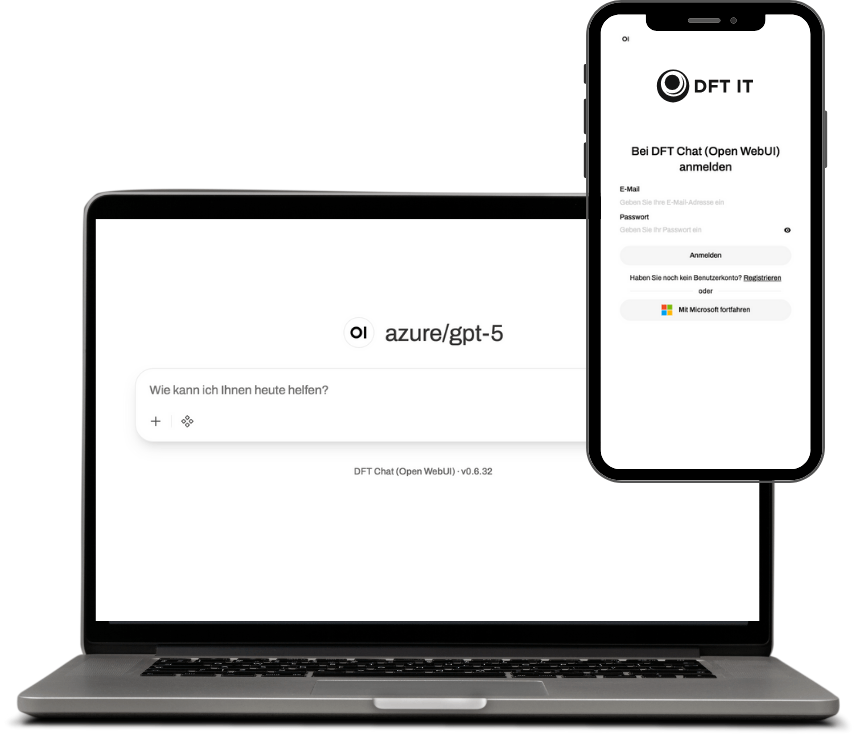

Generative KI – Ihre eigene Chat‑Plattform

Ob sicher in der Azure Cloud, hybrid oder vollständig lokal auf Ihren eigenen Servern – wir bringen Generative KI mit voller Kontrolle in Ihr Unternehmen.

- Volle Datenhoheit & DSGVO‑Konformität

- Eigenes Branding, Microsoft SSO & Rollen

- Beste Modelle – Cloud, Hybrid oder vollständig On‑Premise

Drei Deployment‑Szenarien

Vom Cloud‑Betrieb bis zum vollständig abgeschotteten On‑Premise‑LLM – wir liefern die passende Architektur.

Azure Cloud

Managed oder Own & Control

Betrieb in Ihrer Azure‑Umgebung mit Azure OpenAI, DSGVO‑konform in EU‑Regionen und nahtloser Integration in Microsoft 365.

- GPT‑4o, GPT‑5 & weitere Azure‑Modelle

- Single Sign‑On über Microsoft Entra ID

- Verträge mit EU‑Datenverarbeitung

Hybrid‑Setup

Cloud + lokale Modelle kombiniert

Sensible Workloads laufen lokal, rechenintensive Anfragen optional in der Cloud. Routing über LiteLLM – flexibel und steuerbar.

- Automatisches Routing nach Datenklassifizierung

- Kombination aus Azure OpenAI und lokalen LLMs

- Feingranulare Policies pro Team oder Use Case

Vollständig lokal (On‑Premise)

Air‑Gapped auf Ihren Servern

Das komplette LLM läuft auf Ihrer Hardware – ohne Internet, ohne externe APIs. Maximale Datensouveränität für regulierte Branchen.

- Open‑Source‑Modelle (Llama, Mistral, Qwen u. a.)

- GPU‑Betrieb via Ollama, vLLM oder TGI

- Air‑Gapped Betrieb – 100 % offline möglich

Anwendungsfälle aus der Praxis

So setzen unsere Kunden Generative KI produktiv ein.

Wissensassistenz

KI‑Chatbot mit Zugriff auf Ihre internen Dokumente, Wikis und Handbücher per Retrieval‑Augmented Generation.

Dokumentenanalyse

Automatisches Extrahieren, Zusammenfassen und Klassifizieren von Verträgen, Angeboten und Berichten.

Code & DevOps

Privater Coding‑Assistent für Entwickler‑Teams – ohne dass Ihr Source‑Code an externe Anbieter gelangt.

Modelle der Zusammenarbeit

Drei Wege zu Ihrer eigenen KI-Plattform – wir beraten Sie zur besten Option.

Managed Service

Ideal für KMU und Start-ups mit Wunsch nach betriebsbereiter Lösung und planbaren Kosten.

- Schlüsselfertige Bereitstellung, Branding und Konfiguration

- Betrieb, Updates, Monitoring und Backups inklusive

- Zugriff über Microsoft SSO, Rollen & Unternehmensrichtlinien

- Transparente Kostendarstellung der Modell-/Token-Nutzung

Own & Control

Für Unternehmen mit eigenem Azure-Vertrag, die maximale Kontrolle wünschen.

- Installation & Konfiguration direkt in Ihrer Azure-Instanz

- Vollständige Kostenkontrolle über Ihren eigenen Azure-Vertrag

- Admin-Training und Übergabe der Betriebsdokumentation

- Optional: Wartung, Support-Kontingente und Weiterentwicklung

On-Premise LLM

Für regulierte Branchen & sicherheitskritische Umgebungen – komplett lokal, optional air-gapped.

- Lokales LLM (Llama, Mistral, Qwen u. a.) auf Ihrer Hardware

- Hardware-Beratung & GPU-Dimensionierung

- Modellauswahl, Feintuning und RAG auf Ihren Daten

- Betrieb ohne Internet – Air-Gapped möglich

- Wartung, Updates & Support auf Wunsch

Häufige Fragen

Antworten auf die wichtigsten Fragen zu unserer KI‑Plattform.

Welche Deployment‑Optionen gibt es?

Wir bieten drei Deployment‑Modelle: vollständig in Azure (Managed oder Own & Control), hybrid mit intelligentem Routing sowie vollständig lokal auf Ihren eigenen Servern – optional komplett ohne Internetverbindung (Air‑Gapped).

Ist die Plattform DSGVO‑konform?

Ja. In allen Deployment‑Szenarien verlassen Ihre Daten Ihre definierte Umgebung nicht. Prompts werden niemals zum Training von Modellen verwendet und wir schließen bei Bedarf entsprechende Auftragsverarbeitungsverträge (AVV).

Können wir später die Modelle wechseln?

Ja. Durch den Einsatz von LiteLLM als Gateway bleiben Sie flexibel. Sie können jederzeit neue Modelle hinzufügen, austauschen oder Anfragen auf mehrere Modelle verteilen – ohne Änderungen in Ihren Anwendungen.

Bereit für Ihre eigene KI‑Plattform?

Lassen Sie uns kurz und unverbindlich klären, welches Deployment‑Modell – Cloud, Hybrid oder vollständig lokal – am besten zu Ihren IT‑ und Compliance‑Anforderungen passt.